Segment Anything(SAM)是什么

Segment Anything(SAM)是Meta AI(原Facebook)于2023年4月发布的开源图像分割模型,能够根据用户提供的点、框、文本等提示信息,实现对图像中任意物体的像素级精确分割。该模型在超过10亿个掩码的SA-1B数据集上训练,具备强大的零样本泛化能力,无需针对特定任务微调即可处理各种图像分割任务,被誉为计算机视觉领域的"分割基础模型"。

Segment Anything(SAM)的主要功能

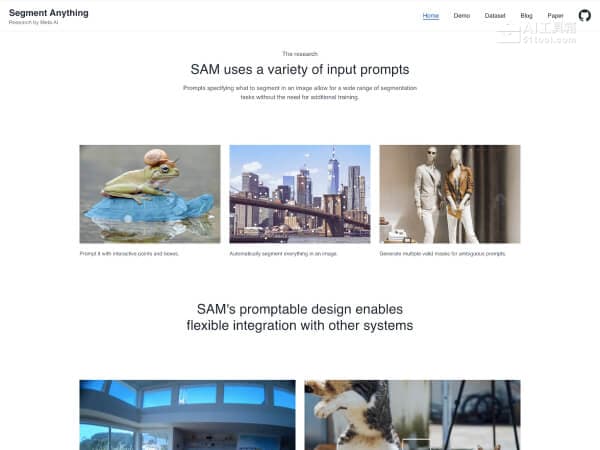

交互式分割:支持通过点击、框选、文本描述等多种方式指定分割目标,用户只需简单操作即可获得高质量的分割掩码,大幅提升标注效率。

自动分割:能够自动识别图像中的所有显著物体并生成分割掩码,无需人工干预,适用于大规模图像处理任务。

零样本泛化:在训练过程中未见过的物体类别和图像类型上也能实现准确分割,支持跨域迁移到医学影像、遥感图像等专业领域。

多掩码输出:对于模糊提示,模型会输出多个候选掩码(整体、部分、子部分),用户可根据需求选择最合适的结果。

Segment Anything(SAM)的使用方法

- 安装环境:通过pip安装SAM库(

pip install git+https://github.com/facebookresearch/segment-anything.git),下载预训练模型权重。 - 加载模型:使用

sam_model_registry加载指定版本的ViT模型(ViT-H、ViT-L或ViT-B),初始化预测器。 - 设置图像:调用

predictor.set_image()方法对图像进行预处理,生成图像嵌入。 - 提供提示:通过点坐标、边界框或文本提示指定分割目标,调用

predictor.predict()方法生成分割掩码。 - 查看结果:模型会返回多个候选掩码及其置信度分数,用户可选择最合适的掩码进行后续处理。

Segment Anything(SAM)的产品价格

Segment Anything(SAM)是完全免费的开源软件,采用Apache 2.0开源许可证,用户可以免费使用、修改和分发。模型本身不收取任何费用,用户只需承担训练和推理过程中使用的计算资源成本(如GPU租赁费用、云服务器费用等)。

Segment Anything(SAM)的适用人群

AI研究人员和学者:需要处理大规模图像分割任务的研究人员,SAM可显著降低数据标注成本,加速研究进程。

计算机视觉工程师:开发图像处理、目标检测、视频跟踪等应用的工程师,SAM可作为核心组件集成到各类视觉系统中。

数据标注人员:从事图像标注工作的专业人员,SAM的交互式分割功能可大幅提升标注效率和质量。

内容创作者:从事图像编辑、视频制作、AR/VR开发的内容创作者,SAM可快速提取图像中的任意物体,简化创意工作流程。

总而言之,Segment Anything(SAM)是一款由Meta AI开发的开源图像分割基础模型,通过支持点、框、文本等多种提示方式,实现对图像中任意物体的像素级精确分割,具备零样本泛化能力和实时交互性能,适用于AI研究、计算机视觉开发、数据标注和内容创作等多种场景。